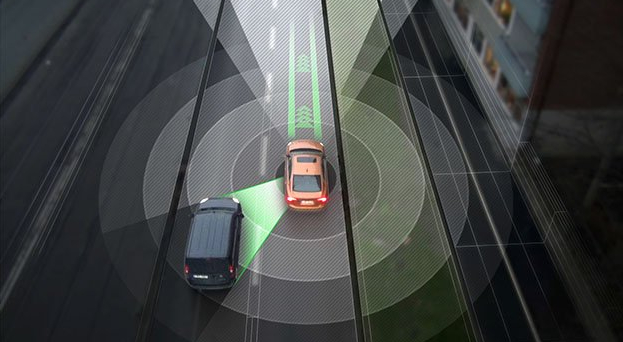

谷歌无人驾驶汽车该是设计出来保护自己乘客安全的。那么,在看着要出交通事故的情况下,你所在的车子该采取一切战斗的姿态保证你的安全;如同都教授。

可要是路上这样的车子有很多呢,它们彼此通气,同时还要各为其主?无人驾驶汽车面临的抉择不亚于哈姆雷特。只有自己一辆车无论如何很好办,它只需谨记其最高指示:「保护我的乘客,使他们免受伤害。」可这些车子一旦连接起来,它们的最高指示就会变成:「将伤亡人数最小化。」而这样的一条指示就会产生这么一种可能,某辆车牺牲自己的主人,以减少伤亡总数。Asimov 的机器人原则并未提供应对这样一种情境的策略,即这些机器人随时保持连接,并且它们身体里还包藏着脆弱的人类。

举个例子,一个行人不期然地冲进一条繁忙的街道。街上的无人驾驶汽车们迅速合计了一下,并以数学原理设计出一个方案保全了这位行人,不过代价却是两辆车发生了小刮蹭,但要是恰好我所在的那辆车把自己开上一个混凝土桩里,95%我是死翘翘了。其它别的方案也好不到哪去,说不定更糟,这里的糟糕状况包括经济损失、人员伤害,甚或死亡。

总而言之,一个车辆机器人联盟将改变规则,进而指导它们的行为。未联网机车或许还能做个无视全局的特立独行者,不考虑其他车辆,只在意自己乘客的安全;而联网车辆将会采取某种形式的实用主义,试图将集体损失最小化。这,也或许是我们想要的。不是吗?

不过这种实用主义也存在一个问题,就是人们对何谓价值,价值几钱莫衷一是。保全一个行人真的就比保全一位乘客重要吗?保全人类的尝试就总是对的吗?不管这一尝试的行动是多么胜算渺茫?也不管这一尝试会带来多少连锁伤害?这辆车应该像默认乘客已经系好安全带一样行事吗,因为这些乘客有义务这么做?车子是否更该牺牲耄耋老者而不是年轻人,因为年轻人还有大好的韶光?另外,请大家想一下孩子们,那些可爱的唱诗班的天使们……

我们并不擅长做出这些抉择,甚至论及此,都没办法心平气和地讨论。想起另一个例子,许多适用于公共场合的规则可以基于公平进行优化:每个人都在等这同一个红灯,除非你有什么不寻常的事:比如你在追一个坏人,或者在送一个需要急救的人——否则你不可以闯红灯。不幸的是,我们在并没有一致的价值观,也无法由此作出一致的决定。我们退行到号召公平,假装胜券在握。或者干脆把这头疼的问题留给专家,比如决定谁合该得到器官移植这种问题。不过结果却是,我们在士兵冒着生命危险去营救被缚的战友是否值得这种问题上,依然没办法一拍即合。啊,算了,有选择强迫症的我们,不必纠结这些疑难的道德选择,留给无人驾驶汽车编程者算了。

想象一条充斥了无人驾驶汽车的道路;想象谷歌依然像如今一统安卓,其他汽车贴着它的标牌到处跑;设想这些汽车之间彼此相连。我们能否假设谷歌支持联网道路中立原则,所有车辆适用相同规则,没有基于内容(也就是车里的乘客)、出发点、目的地或者旅行目的的歧视?再者,谷歌会允许你花钱「买路」么?(出于网络优化的考虑,快车道并非哪条指定道路,倒是更像动态赋予的事件。)让一辆急救车先行通过我们可能没啥意见,要是配合一个土豪花钱走后门,设计出这样一种程序,无人驾驶汽车看到一辆车亮起「Move Aside」(走开!)就立即纷纷闪出一条道来呢?

额,还是让我们先假设谷歌严格厉行联网道路中立原则。不过,设想美国第 2 大宽带运营商 Comcast 也来做汽车,并将汽车程序设置成超过那些循规蹈矩的汽车。那么谷歌无人驾驶汽车会采取措施阻止 Comcast 汽车超车改道么?形成个汽车圈把它们封锁起来?这是合法的吗?在公共道路上出售快车道是合法的吗?谁来裁决?FCC?

只有一样事是确定的:这将是个说客纵横捭阖的黄金时代。

里面涉及到人类伦理道德等各个方面, 和哈佛公开 Michael J. Sandel 所演讲的关于 Justice 类似. 纠结

是啊。不知道你看我上一篇了没有,http://geekcar.net/archives/2562 这个我觉得探讨的要更为深入些,也更加纠结……